**MIT突破性成果登顶Nature子刊!**科学家受线虫微型大脑启发,研发出革命性19节点液态神经网络系统。这一脑启发的AI架构在自动驾驶控制任务中展现出惊人表现:仅用传统神经网络万分之一规模的神经元数量,即实现更优性能表现。

该系统的核心优势在于其动态适应能力——不同于固定架构的传统模型,液态神经网络能在运行时持续学习并适应新数据流,展现出类脑的灵活性与环境交互能力。研究证实,这种生物启发算法在实时性、能效比及小样本学习等关键指标上均超越主流深度学习方案,为边缘计算、自主机器人等场景提供了全新的高效AI范式。

一、Generalized Framework for Liquid Neural Network upon Sequential and Non-Sequential Tasks

1.方法

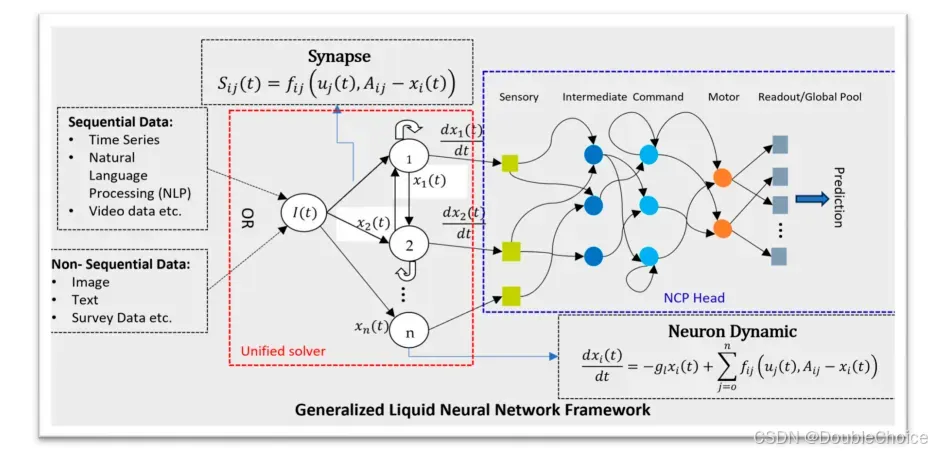

1. 广义液态神经网络框架(GLNN)

- 提出一种新型液态神经网络框架,通过整合Runge-Kutta DOPRI 5方法,增强动态系统模拟能力。

- 将时间依赖的微分方程模型转换为时间独立的稳态模型(即系统达到平衡状态,满足dy/dx=0)。

- 通过稳态条件推导和非线性函数的泰勒展开线性化,解决非序列任务中的静态分析问题。

- 采用Dormand-Prince数值方法求解动态微分方程,支持自适应步长和误差控制。

2. 统一求解器与神经回路策略(NCP)的集成

- 将神经回路策略(NCP)与液态神经网络结合,模仿线虫的层次化神经元结构(感觉神经元、中间神经元、命令神经元、运动神经元)。

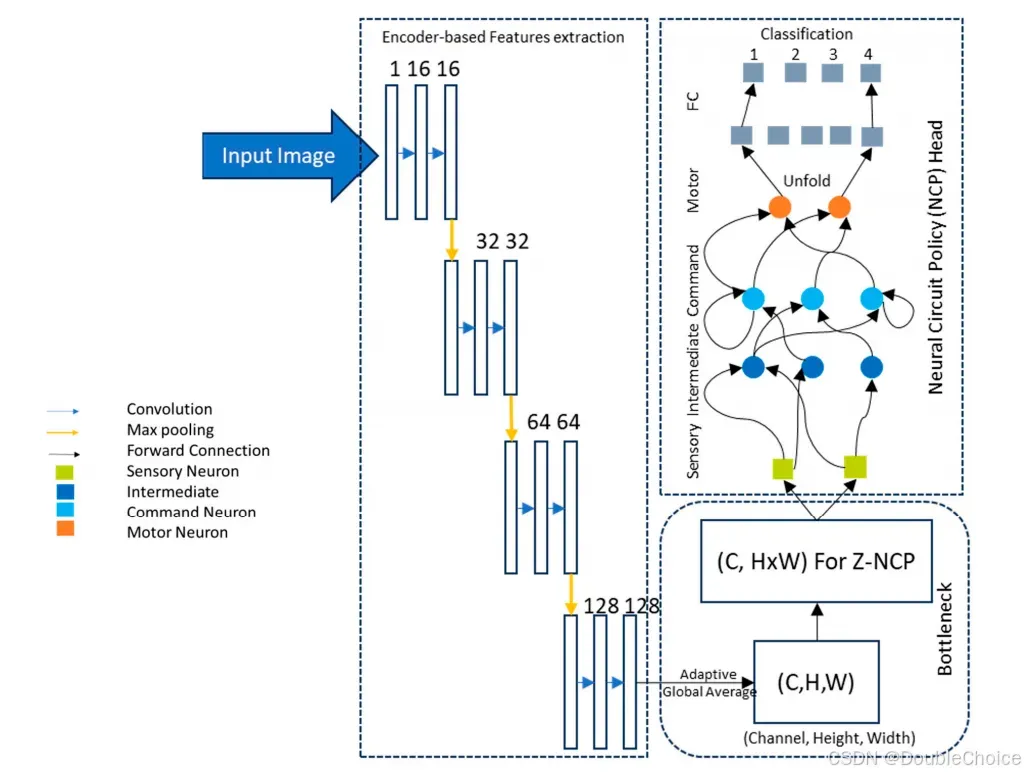

- 在医疗图像分类任务中,采用Z-NCP序列建模技术,沿图像深度方向分割通道层,提升特征提取能力。

3. 应用案例实现

- 阻尼正弦轨迹预测:通过神经ODE和液态神经网络的联合优化,结合伴随敏感度算法进行梯度计算。

- 非线性RLC电路建模:利用状态空间方程描述电路动态,并引入电感随电流变化的非线性关系。

- 视网膜疾病分类:基于OCTMNIST数据集,使用编码器提取图像特征,通过NCP头部实现疾病分类。

2.创新点

1. 非序列任务扩展

- 首次将液态神经网络的应用从序列任务(如时间序列预测)扩展到非序列任务(如图像分类和电路建模),突破了传统LNN的局限性。

2. Runge-Kutta DOPRI方法整合

- 将高阶数值微分方程求解器嵌入神经网络框架,提升动态系统建模的稳定性和计算效率。

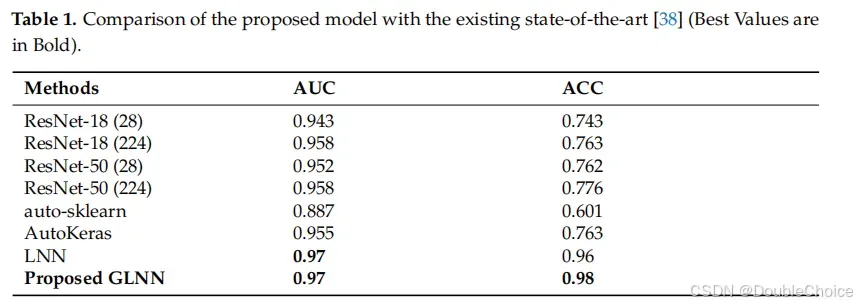

3. 性能显著提升

- 在阻尼正弦轨迹预测任务中,GLNN的损失值显著低于神经ODE和传统LNN。

- 非线性RLC电路建模精度提升20%(GLNN精度0.95 vs. LNN 0.75)。

- OCT图像分类的F1分数达到0.98,比传统LNN提高10%。

4.生物启发式架构

- 通过仿生学设计(如线虫神经结构)优化网络层次,增强模型对复杂动态的适应能力和可解释性。

5. 统一动态与稳态分析

- 通过单一框架同时支持动态过程模拟和稳态分析,简化了复杂系统的建模流程。

论文链接:https://www.mdpi.com/2227-7390/12/16/2525

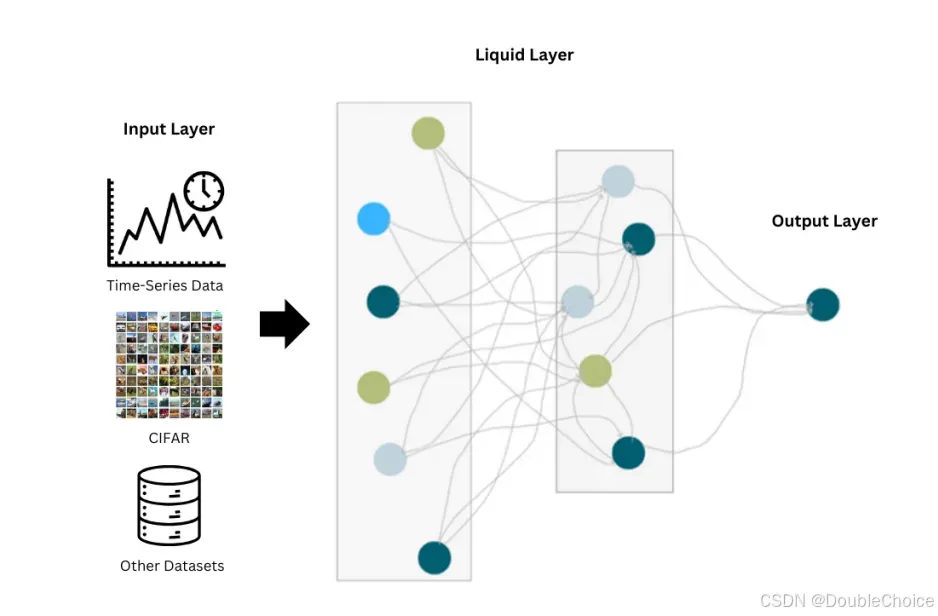

二、Exploring Liquid Neural Networks on Loihi

1.方法

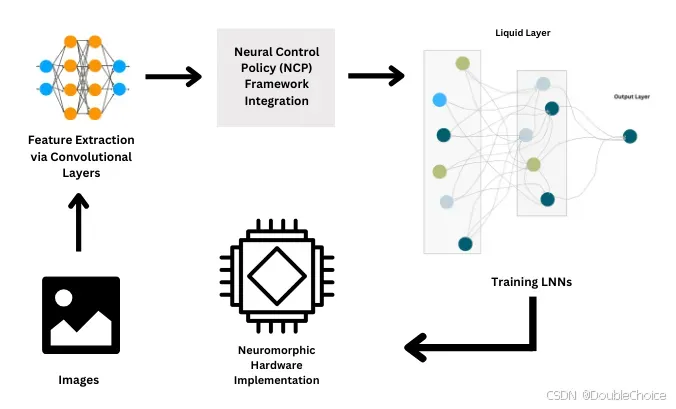

1. 模型架构设计

- 提出LNN模块,通过级联卷积层逐步降低数据维度,生成抽象表征,并利用神经电路策略(NCP)进行决策。

- 动态调整网络结构和参数,通过微分方程建模神经元通信,实现连续时间动态系统。

2. 训练与优化

- 采用反向传播和Adam优化器进行循环训练,优化模型参数以提高预测精度。

- 为适应边缘设备的资源限制,对模型进行量化(减少参数敏感性)和转换(适配不同硬件平台)。

3. 硬件部署

- 在Loihi-2神经形态芯片上部署模型,利用其异步事件驱动的计算特性,实现高效能、低能耗的推理。

- 使用LAVA框架将模型编译为Loihi-2可执行格式,并验证其兼容性与实时性。

4. 计算资源管理

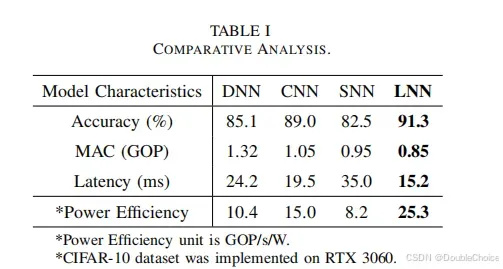

- 定义了MAC(乘加操作)的计算模型,包括嵌入层、动态适应层和处理层的操作量分析,优化整体吞吐量。

2.创新点

1. 高效能低能耗的硬件集成

- 首次在Loihi-2芯片上实现LNN,在CIFAR-10数据集上达到91.3%准确率,每帧能耗仅213微焦耳,显著优于传统DNN、CNN和SNN模型。

2. 动态适应性与稳定性

- 通过微分方程建模神经元动态特性,无需循环连接即可保持系统稳定性,且能根据输入动态调整网络参数,适应复杂时序数据。

3. 跨领域应用潜力

- 展示了LNN在无线通信(MIMO信道预测)、自动驾驶(CALNet多传感器融合)、医疗(实时患者数据分析)等领域的实际应用案例。

4. 算法-硬件协同设计

- 提出LTC-SE算法优化资源受限场景下的计算效率,结合神经形态硬件的并行性和低功耗特性,为边缘计算提供新范式。

5. 理论创新

- 融合生物神经元模型与连续时间动态系统理论,提升LNN对时序依赖的建模能力。

论文链接:https://arxiv.org/abs/2407.20590

文章来源:微信公众号-AI前沿速递,原始发表时间:2025年03月31日。